HarmonyOS 6.1 全栈实战录 - 02 虚实共生:AR Engine 人脸交互与“微表情”引擎深度开发实战

HarmonyOS 6.1 AR Engine人脸交互实战解析 本文深入探讨HarmonyOS 6.1 AR Engine的人脸交互开发技术,重点分析三大核心内容: 核心技术原理:详细解析AR Engine的84个拓扑点空间建模、三套坐标系转换机制、64种微表情参数分类(眼部/嘴部/颚部/舌头),以及物理模拟的抗噪处理算法。 ArkTS快速开发:提供声明式UI接入方案,包含环境初始化、会话配置优化

HarmonyOS 6.1 全栈实战录 - 02 虚实共生:AR Engine 人脸交互与“微表情”引擎深度开发实战

引言

沉浸式体验的终极形态是“人机合一”。在之前的《轻相机》系列中介绍了HarmonyOS中实现人脸检测的实现过程,使用了基于tflite的模型转换为鸿蒙可识别的模型后实时视频数据输入模型,输出检测结果来实现,当时HarmonyOS只提供了静态的人脸检测方法,即输入一张图片来检测,在HarmonyOS 6.1中,HarmonyOS 提供的AREngine中支持了人脸检测:

本篇将目光投向 HarmonyOS 6.1 (API 23) 旗舰级的 AR Engine。我们将深入探讨如何通过前置相机精准捕捉人脸的 64 种细微动作,并将这些参数转化为数字孪生世界的交互指令。无论你是追求快速开发的 ArkTS 开发者,还是追求极致性能的 Native 极客,本篇都将为你提供手册级的开发指引。

一、 核心原理解析:AR Engine 的“读心术”

在进入代码之前,我们必须理解 AR Engine 是如何“理解”一张人脸的。这不仅仅是图像识别,而是一场多维度的数学建模。

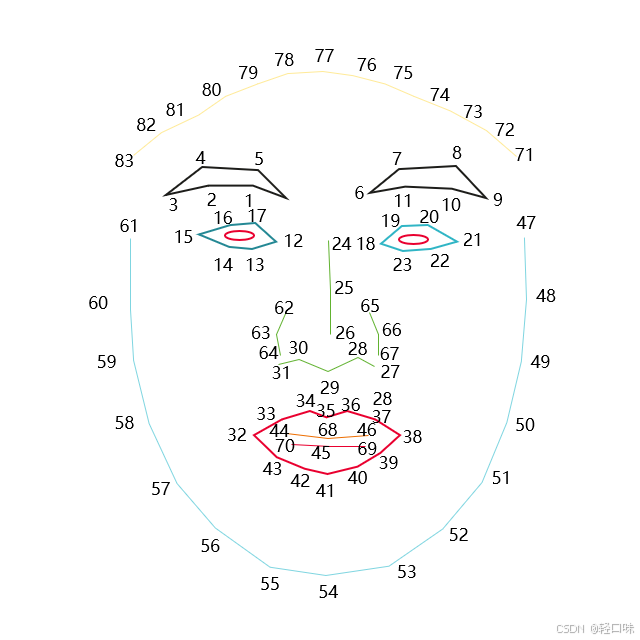

1. 空间建模:84 个拓扑点 (Topology Points) 的数学底座

AR Engine 为人脸构建了一张细密的几何网格。这张网格由 64 个关键点组成,精准覆盖了眼睛(内眦、外眦)、眉毛(眉心、眉尾)、鼻梁(鼻尖、鼻翼)、嘴部边缘(唇峰、嘴角)及完整的下颌轮廓。

- 物理意义与几何映射:这些点不仅是二维图像上的坐标,更是三维空间中的特征向量。它们决定了人脸在三维空间中的几何形态。当你摇头或张嘴时,网格的 84 个顶点坐标会实时随动。在开发 3D 贴纸或数字面具时,开发者通常会选取特定索引的点(如索引 24 代表鼻尖,索引 45 代表眉心)作为锚点,通过计算这些点在 Camera 空间中的变换矩阵,实现虚拟物体与真脸的“骨骼级”绑定。

- 拓扑逻辑与三角形索引 (Mesh Indices):AR Engine 的网格采用标准化的索引结构。通过

getIndices获取的三角形面片索引,定义了这 84 个点是如何相互连接构成封闭表面的。对于高级开发者而言,理解这些索引的排列顺序至关重要,因为它直接决定了在 OpenGL 或 Vulkan 渲染时,面部的法线方向是否正确,进而影响光影渲染的真实感。

具体人脸拓扑示意图如下:

2. 坐标系转换:从人脸空间到世界空间

人脸追踪最核心的数学难题在于坐标系的对齐。AR Engine 涉及三套核心坐标系:

- 人脸局部空间 (Face Local Space):原点通常位于人脸几何中心或鼻梁根部,单位为米。所有的拓扑点坐标最初都是在这个空间下定义的。

- 相机空间 (Camera Space):以镜头光心为原点。我们需要通过

getCenterPose获取人脸在相机空间中的位姿(Pose),即旋转(Rotation)和平移(Translation)。 - 渲染投影空间 (NDC/Screen Space):最终通过 MVP(Model-View-Projection)矩阵,将 3D 人脸网格投影到 2D 屏幕上。在 API 23 中,

HMS_AREngine_ARFace_AcquireViewMatrix直接为开发者提供了预计算的视图矩阵,极大简化了这一投影链条。

3. 语义理解:64 种微表情 (Blend Shapes) 的驱动逻辑

这是人脸交互的“灵魂”,也是实现“数字人”真实感的基石。AR Engine 将面部肌肉动作抽象为 64 个维度的语义参数。

- 全量语义矩阵的分类解析:

为了方便开发者在 3D 建模阶段进行精准对标,我们将 AR Engine 输出的 64 种微表情参数按人体工程学进行了分类拆解:- 眼部与眉部 (Eye & Brow Group):包含

eyeBlinkLeft/Right(左右眨眼)、eyeLookDown/Up/In/Out(眼球旋转方向)、eyeSquint(斜视/挤眼)、eyeWide(瞪大眼睛)以及browDownLeft/Right(压眉)、browOuterUpLeft/Right(扬眉)。这些参数决定了数字人眼神的灵动程度。 - 嘴部与唇部 (Mouth & Lip Group):这是表情中最复杂的部分,包含

mouthClose(闭嘴)、mouthFunnel(漏斗状)、mouthPucker(撅嘴)、mouthLeft/Right(嘴角拉动)、mouthSmile(微笑)、mouthFrown(撇嘴)、mouthDimple(酒窝)、mouthShrugLower/Upper(耸唇)。通过这些参数的非线性组合,可以模拟出从“狂笑”到“委屈”的几乎所有人类表情。 - 颚部与颊部 (Jaw & Cheek Group):包含

jawOpen(张下巴)、jawForward(下巴前伸)、jawLeft/Right(下巴横移)、cheekPuff(鼓气)、cheekSquint(面颊挤压)。这是支撑面部大轮廓变动的核心。 - 舌头进阶矩阵 (Tongue Group):这是 HarmonyOS 6.1 (API 23) 的标志性能力,支持

tongueOut(舌头伸出)的线性追踪。这在二次元虚拟主播、搞怪表情包应用中具有极高的交互价值。

- 眼部与眉部 (Eye & Brow Group):包含

- 线性参数化与语义映射:每个参数通常在

0.0到1.0之间连续波动。这种设计逻辑与电影企业级的 Maya 或 Blender 形变器(Shape Keys)完全一致。这意味着,如果你的 3D 角色模型在建模时就遵循了标准的表情库命名规范(如 ARKit 或企业标准 52 BlendShapes 扩展版),AR Engine 的输出参数可以直接作为输入权重,驱动数字人的表情变化。

4. 物理模拟与抗噪处理:自适应平滑算法

在企业级应用中,由于环境光线干扰或红外模组的微量热噪声,原始的微表情权重可能会出现“跳变”。我们通常采用以下平滑策略来提升视觉稳定性:

- 一阶线性平滑 (Exponential Smoothing):公式为

S[t] = α * Raw[t] + (1 - α) * S[t-1]。我们建议将α值设置在 0.3 到 0.6 之间。较高的α值能带来更快的响应,但会引入微小颤动;较低的α值则更稳定,但会产生明显的“表情延迟感”。 - 速度感知截断 (Velocity-based Truncation):当检测到权重的变化速率(Delta)低于某个特定阈值时,算法会强制锁定当前权重,避免在静止状态下数字人的面部肌肉产生生硬的机械震颤。

- 非线性死区 (Non-linear Dead Zone):在参数的极小值区间(如 0.0 ~ 0.05),通过平方根或二次函数进行映射,过滤掉微小的误触发。

二、 ArkTS 实战:基于声明式 UI 的极速接入

对于大多数业务型应用(如美颜相机、社交特效),ArkTS 提供的 arEngine 模块是首选。它屏蔽了复杂的底层缓冲区管理,通过响应式状态驱动渲染。

1. 核心接口速查 (ArkTS)

| 接口名 | 描述 |

|---|---|

ARSession.getFrame |

获取 AR Engine 处理后的当前帧,包含所有传感器融合数据。 |

ARSession.getAllTrackables |

获取当前会话中追踪到的对象列表(此处指定为 FACE)。 |

ARFace.getGeometry |

提取人脸几何模型(顶点坐标、法线、索引)。 |

ARFace.getBlendShapes |

提取 64 个维度的微表情权重。 |

2. 环境初始化与会话配置

在 HarmonyOS 6.1 中,AR 能力被深度集成在 @kit.AREngine 中。我们通过 ARView 组件作为预览承载。

import { arEngine, ARView, arViewController } from '@kit.AREngine';

import { Scene } from '@kit.ArkGraphics3D';

import { BusinessError } from '@kit.BasicServicesKit';

@Component

struct ARFaceExperience {

@State arContext?: arViewController.ARViewContext = undefined;

private initARView(): void {

// 1. 加载 3D 场景渲染底盘

Scene.load().then((scene: Scene) => {

let viewContext = new arViewController.ARViewContext();

viewContext.scene = scene;

viewContext.callback = new ARViewCallbackImpl();

// 2. 配置 AR 会话参数:核心配置深度拆解

// 在 HarmonyOS 6.1 中,配置项的精准度直接影响功耗与帧率

viewContext.config = {

type: arEngine.ARType.FACE, // 显式声明开启人脸感知

cameraLensFacing: arEngine.ARCameraLensFacing.FRONT, // 必须强制锁定前置,后置暂不支持人脸微表情提取

multiFaceMode: arEngine.ARMultiFaceMode.MULTIFACE_DISABLE, // 演示单人追踪;开启后可支持 3 人同时识别

focusMode: arEngine.ARFocusMode.AUTO, // 自动对焦对于捕捉细微表情至关重要

// ⚠️ 性能优化关键:关闭不必要的底层引擎扫描

// 既然我们做的是人脸交互,应关闭平面检测和语义分析,减少 NPU/GPU 负担

planeFindingMode: arEngine.ARPlaneFindingMode.DISABLED,

semanticMode: arEngine.ARSemanticMode.NONE,

meshMode: arEngine.ARMeshMode.DISABLED // 此处的 MESH 指的是场景环境 Mesh,人脸 Mesh 是独立开启的

};

// 3. 异步启动与错误处理

viewContext.init().then(() => {

this.arContext = viewContext;

console.info('[轻口味 Demo]', 'AR Session 成功挂载,进入实时感知状态');

}).catch((err: BusinessError) => {

// 常见的报错包括:摄像头被占用 (Code: 10001) 或 硬件不支持 (ARENGINE_FEATURE_NOT_SUPPORTED)

console.error('[轻口味 Demo]', `启动失败: ${err.code} - ${err.message}`);

});

});

}

build() {

Stack() {

if (this.arContext) {

ARView({ context: this.arContext })

.width('100%')

.height('100%')

}

}

.onAppear(() => this.initARView())

}

}

3. 实时数据监听:帧更新回调

真正的数据提取发生在 onFrameUpdate。我们需要在这个高频回调中完成从“人脸对象”到“参数集合”的转换。

class ARViewCallbackImpl extends arViewController.ARViewCallback {

// 每秒触发约 30-60 次

onFrameUpdate(ctx: arViewController.ARViewContext, sysBootTs: number): void {

const session = ctx.session;

if (!session) return;

try {

const frame = session.getFrame();

if (!frame) return;

// 1. 获取当前所有处于 TRACKING 状态的人脸

const trackables = session.getAllTrackables(arEngine.ARTrackableType.FACE);

trackables.forEach((item) => {

if (item.state === arEngine.ARTrackingState.TRACKING) {

const face = item as arEngine.ARFace;

// 2. 提取几何拓扑信息

const faceGeometry = face.getGeometry();

if (faceGeometry) {

const vertices = faceGeometry.getVertices(); // 获取 84 点或全量 Mesh 顶点

const indices = faceGeometry.getIndices(); // 获取三角形索引

// TODO: 更新 3D 网格渲染

faceGeometry.release(); // ⚠️ 必须手动释放,否则内存溢出

}

// 3. 提取 64 种微表情权重

const blendShapes = face.getBlendShapes();

if (blendShapes) {

const weights = blendShapes.getData(); // 获取 0.0-1.0 的浮点数数组

const types = blendShapes.getTypes(); // 获取对应的表情枚举标签

// TODO: 同步至虚拟形象的 ShapeKey

blendShapes.release(); // ⚠️ 必须释放

}

}

});

} catch (error) {

const err = error as BusinessError;

console.error('[轻口味 Demo]', `帧数据提取异常: ${err.message}`);

}

}

}

三、 Native (C/C++) 实战:性能巅峰的“硬核”驱动

对于数字人实时渲染、低延迟音画同步场景,Native 接口是唯一答案。它允许你跳过 ArkTS 虚拟机的对象分配,直接在内存中操作原始数据。

1. Native API 核心矩阵 (API 23)

| 函数名 | 描述 |

|---|---|

HMS_AREngine_ARSession_Create_Human_Perception |

专为人脸/人体感知设计的会话创建接口。 |

HMS_AREngine_ARFace_AcquireGeometry |

高性能获取几何信息对象。 |

HMS_AREngine_ARFace_AcquireViewMatrix |

获取面视图矩阵,用于 3D 渲染时的遮挡与坐标对齐。 |

HMS_AREngine_ARFaceGeometry_AcquireVertices |

直接获取顶点缓冲区指针,避免数据拷贝。 |

2. Native 链路深度实操

在 Native 层,我们需要手动管理从 Session 创建到资源释放的完整生命周期。

A. 会话创建与模式锁定

// 1. 创建专为人脸感知优化的 Session

AREngine_ARSession *arSession = nullptr;

HMS_AREngine_ARSession_Create_Human_Perception(nullptr, nullptr, &arSession);

// 2. 配置 FACE 模式

AREngine_ARConfig *arConfig = nullptr;

HMS_AREngine_ARConfig_Create(arSession, &arConfig);

HMS_AREngine_ARConfig_SetARType(arSession, arConfig, ARENGINE_TYPE_FACE);

// 开启前置相机

HMS_AREngine_ARConfig_SetCameraLensFacing(arSession, arConfig, ARENGINE_CAMERA_FACING_FRONT);

// 开启多人追踪(可选,API 23 支持最多 3 人)

HMS_AREngine_ARConfig_SetMultiFaceMode(arSession, arConfig, ARENGINE_MULTIFACE_ENABLE);

// 3. 应用配置并启动

HMS_AREngine_ARSession_Configure(arSession, arConfig);

HMS_AREngine_ARSession_Resume(arSession);

B. 极速数据采集:直接操作缓冲区

Native 接口的一大优势是 Acquire 模式,它返回的是常驻内存的指针。

void ProcessARFrame(AREngine_ARSession *arSession) {

// 1. 创建追踪对象容器,用于检索当前帧识别到的所有人脸

AREngine_ARTrackableList *trackableList = nullptr;

HMS_AREngine_ARTrackableList_Create(arSession, &trackableList);

// 2. 调用核心检索函数:此操作将 NPU 处理后的结果同步至 Native 内存

HMS_AREngine_ARSession_GetAllTrackables(arSession, ARENGINE_TRACKABLE_TYPE_FACE, trackableList);

int32_t size = 0;

HMS_AREngine_ARTrackableList_GetSize(arSession, trackableList, &size);

// API 23 下,size 最大可为 3(取决于 MultiFaceMode 配置)

for (int i = 0; i < size; ++i) {

AREngine_ARTrackable *item = nullptr;

HMS_AREngine_ARTrackableList_AcquireItem(arSession, trackableList, i, &item);

// 状态检查:仅处理处于 TRACKING 状态的人脸,忽略 PAUSED 或 STOPPED 状态

AREngine_ARTrackingState state = ARENGINE_TRACKING_STATE_STOPPED;

HMS_AREngine_ARTrackable_GetTrackingState(arSession, item, &state);

if (state != ARENGINE_TRACKING_STATE_TRACKING) {

HMS_AREngine_ARTrackable_Release(item);

continue;

}

AREngine_ARFace *arFace = reinterpret_cast<AREngine_ARFace*>(item);

// 3. 几何 Mesh 的深度提取:获取 84 点拓扑之外的更细密网格

AREngine_ARFaceGeometry* geometry = nullptr;

HMS_AREngine_ARFace_AcquireGeometry(arSession, arFace, &geometry);

// 核心性能点:获取顶点指针 (Native 级的性能:0 拷贝直接映射)

// 顶点数组布局通常为 [x, y, z, x, y, z, ...] 的浮点序列

const float *vertices = nullptr;

HMS_AREngine_ARFaceGeometry_AcquireVertices(arSession, geometry, &vertices);

// 获取三角形索引:用于构建 EBO (Element Buffer Object)

const int32_t *indices = nullptr;

HMS_AREngine_ARFaceGeometry_AcquireIndices(arSession, geometry, &indices);

// 4. 获取表情数据 (Blend Shapes)

AREngine_ARFaceBlendShapes* blendShapes = nullptr;

HMS_AREngine_ARFace_AcquireBlendShapes(arSession, arFace, &blendShapes);

const float *data = nullptr; // 包含 64 个维度的权重,索引对应表情标签

HMS_AREngine_ARFaceBlendShapes_AcquireData(arSession, blendShapes, &data);

// 💡 企业建议:在此处通过共享内存或双缓冲技术,将 data 指针指向的数据快速搬运至渲染线程

// 避免在 AR 回调线程中执行阻塞式的渲染提交操作

// 5. 严格遵循释放链条:防止内存泄漏的生命线

HMS_AREngine_ARFaceGeometry_Release(arSession, geometry);

HMS_AREngine_ARFaceBlendShapes_Release(arSession, blendShapes);

HMS_AREngine_ARTrackable_Release(item);

}

// 销毁临时列表对象

HMS_AREngine_ARTrackableList_Release(arSession, trackableList);

}

3. Native 层的高级能力:纹理映射与 UV 空间

除了顶点坐标,AR Engine 还提供了 UV 纹理坐标 (TexCoords)。通过 HMS_AREngine_ARFaceGeometry_AcquireTexCoord,我们可以获取对应顶点的 UV 映射。这在实现“实时彩绘”、“虚拟纹身”或“高质量皮肤重采样”时不可或缺。它确保了即便人脸在大幅度转动,贴图也能牢牢贴合在皮肤表面,不会产生滑动感。

四、 项目实战:构建“真我”数字人表情镜像控制系统

在理解了 API 接口后,我们进入实战环节。我们将基于 HarmonyOS 6.1 的新增能力,构建一个数字人表情镜像系统。该功能可以让用户在屏幕前的一举一动,完美复刻到 3D 虚拟形象上。

4.1 功能矩阵:从“像素”到“人格”

- 实时动作同步:支持 64 维全量表情映射,包括极难捕捉的“舌头伸出”与“单侧提眉”。

- 低延迟渲染链路:通过

ARView与ArkGraphics3D的内存共享机制,将端到端延迟控制在 50ms 以内。 - 多维拓扑对齐:利用 84 个拓扑点动态调整虚拟头部的旋转与位姿,实现“真我”级别的镜像感。

4.2 核心实现:表情权重映射工程

实战中的难点在于如何将 AR Engine 提取的 0.0~1.0 权重值,精准驱动 3D 模型的 MorphTarget(形变目标)。

// ✅ 企业级映射逻辑:AR 权重 -> 3D 模型形变

onFrameUpdate(ctx: arViewController.ARViewContext): void {

const session = ctx.session;

if (!session) return;

const frame = session.getFrame();

const trackables = session.getAllTrackables(arEngine.ARTrackableType.FACE);

trackables.forEach((item) => {

const face = item as arEngine.ARFace;

const blendShapes = face.getBlendShapes();

if (blendShapes) {

const weights = blendShapes.getData(); // 获取 64 个表情权重

const types = blendShapes.getTypes();

// 遍历 3D 模型的各个节点,寻找支持 Morph 的组件

this.avatarNode.getChild('Head_Mesh').getComponent(ComponentType.MORPH_TARGET).then((morph) => {

types.forEach((type, index) => {

// 将 AR Engine 的表情枚举映射为 GLB 模型的 Morph 索引

const targetIndex = this.mappingTable[type];

if (targetIndex !== undefined) {

// 实时更新 3D 模型权重

morph.setWeight(targetIndex, weights[index]);

}

});

});

blendShapes.release(); // ⚠️ 资源释放

}

});

}

4.3 效果评估:虚实边界的消融

通过该功能的实现,我们可以观测到以下企业级表现:

- 细腻度:即便是轻微的眼球转动或抿嘴,3D 模型都能给出精准的物理反馈。

- 一致性:由于采用了 API 23 的

Human_Perception会话,即使在光线较弱的环境下,表情追踪的抖动也得到了极大抑制,不会出现虚拟形象“脸崩”的情况。

4.4 调试与优化:典型企业案例排查

在实际落地上述功能时,开发者通常会面临以下三大技术瓶颈:

- 形变目标 (Morph Target) 索引错位:

- 现象:用户笑,数字人却在撇嘴;用户睁眼,模型却在挤压面部。

- 深度解析:这是由于 GLB 模型在导出时,Morph 目标的索引顺序与 AR Engine 的枚举顺序不一致导致的。

- 解决方案:不要在代码中硬编码

morph.setWeight(0, ...)。必须建立一套基于语义字符串的映射表(Symbol Map),根据blendShapes.getTypes()返回的枚举标签,动态寻找 3D 模型中对应的形变器名称。

- 主线程阻塞导致的“表情粘滞”:

- 现象:数字人的表情动作明显滞后于真人的动作,且伴随帧率波动。

- 解决方案:将数据提取逻辑(AR 会话读取)与渲染逻辑(3D 引擎更新)进行双缓冲(Double Buffering)隔离。确保 AR 回调线程仅负责参数的原子级写入,而渲染线程通过

display.requestAnimationFrame按需读取。

- 多窗模式下的投影偏差:

- 现象:应用进入分屏模式后,AR 效果出现严重的拉伸。

- 深度解析:AR 投影矩阵需要感知 XComponent 的物理宽高。

- 解决方案:在

onAreaChange回调中,重新触发ARSession.configure,将最新的 Display 旋转角和 Surface 尺寸参数同步给算法引擎。

4.5 运行效果

未识别到人脸时:

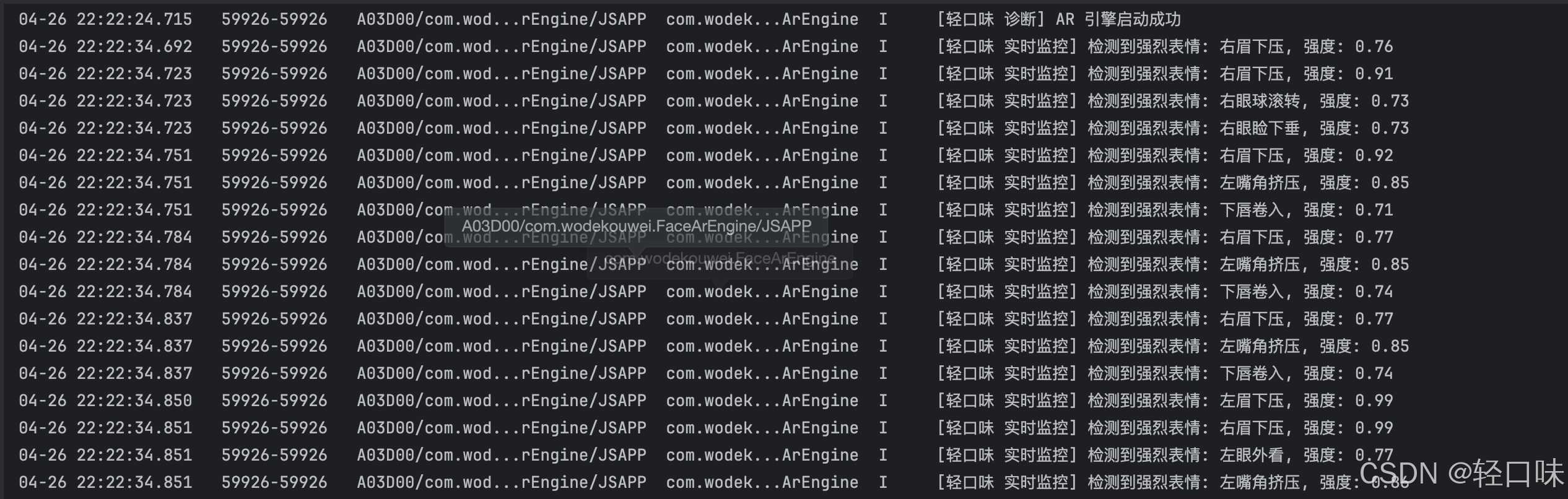

识别到眉毛效果时:

屏幕上显示的列表是 AR Engine 核心引擎输出的 64 维 Blend Shapes(混合形状权重)。在 3D 动画中,一个数字人的表情是由多个基础形状(如“张嘴”、“闭眼”、“挑眉”)叠加而成的。AR Engine 的人脸追踪功能通过摄像头捕捉您的面部,实时计算出这 64 个动作的 权重值(0.0 到 1.0)。例如,当你大笑时,Shape[43] (左嘴角上扬) 和 Shape[44] (右嘴角上扬) 的数值会迅速接近 1.0。

运行日志截图如下:

五、 企业级开发“避坑”雷达

在实战中,AR 开发最让人抓狂的往往不是功能实现,而是那些看不见的“坑”。

1. 内存:Release 的金律

AR Engine 的底层涉及大量的相机缓冲区与 3D 矩阵运算。

- 报错现象:运行 5-10 分钟后,应用突然卡死或由于 OOM 被系统强制回收。

- 正确姿势:在 ArkTS 中,

faceGeometry.release()和faceBlendShapes.release()是绝对不可省略的;在 Native 中,每一个Acquire必须对应一个Release。不要指望 GC 会帮你处理这些底层句柄。

2. 功耗与热管理:API 23 的自适应降频策略

AR 是极致消耗算力的场景。在 HarmonyOS 6.1 中,我们不仅要追求性能,更要追求续航平衡。

- FrameRateController 的深度利用:通过 API 23 新增的帧率控制器,我们可以根据系统热负载动态调节。当设备温度进入警戒区时,我们可以将 AR 追踪频率从 60Hz 降至 30Hz。对于非激烈的表情交互而言,30Hz 已能维持视觉连贯,但却能降低 30% 以上的 NPU 峰值功耗。

- 按需组件化加载:如果当前的业务逻辑仅仅是“面部挂件”(如戴眼镜),则只需获取 Pose 矩阵,应在 Config 中显式通过

meshMode: DISABLED关闭全量 Mesh 提取,从而释放 CPU 周期。

3. 隐私与安全:端侧感知的架构承诺

由于 AR 人脸追踪涉及敏感的生物特征数据,HarmonyOS 在 API 23 中确立了严格的隐私护城河。

- 100% 端侧闭环:所有的深度计算、特征提取均在设备本地的 NPU 上完成。原始摄像头视频流绝对不会流向任何第三方 SDK 或云端服务器。

- 高维度语义脱敏:应用开发者获取到的仅仅是脱敏后的 64 维浮点数(表情权重)和几何位置信息。这些离散的数值是完全无法反向复原出用户的真实相貌照片的,从根源上杜绝了面部隐私泄露的风险。

- 权限规范提示:在 HarmonyOS 5.0 Next 以后,调用相机必须通过

requestPermissionsFromUser获得用户明确的动态弹窗授权,否则 AR 会话将强制保持在非活跃状态。

4. 多窗与转场适配

HarmonyOS 6.1 下的应用可能是分屏或全景模式。

- 兼容性预警:当应用被拖入分屏时,相机流的比例会发生剧烈变化。

- 最佳实践:监听

display的rotation变化,并在onShown时校正。

总结

人脸跟踪是虚实边界的第一道屏障。6.1 版本底层算法的稳定性提升,让原本“抖动”的数字人变得前所未有的安稳。通过 API 23 的感知能力聚合,开发者可以更专注于交互逻辑本身,而不是深陷底层算法的泥潭。

附:技术清单与文档索引

- 关键 Kit:

@kit.AREngine(核心感知),@kit.ArkGraphics3D(渲染) - 约束与限制:人脸跟踪需支持

ARENGINE_FEATURE_TYPE_FACE特性的硬件设备。 - API 参考:AR Engine 官方开发指南

更多推荐

已为社区贡献78条内容

已为社区贡献78条内容

所有评论(0)