HarmonyOS空间音频实战:构建三维沉浸式跨设备音效系统

·

引言

前情提要,元服务应用版本为:Harmony OS 5.0.0

随着万物互联时代的深入,用户对跨设备音频体验的要求已从"能听"升级到"沉浸"。HarmonyOS空间音频技术通过头部追踪、虚拟声场建模和跨设备同步三大核心能力,实现了影院级的三维音效体验。本文将深入解析空间音频的技术架构,并构建一个跨设备全景声影院系统。

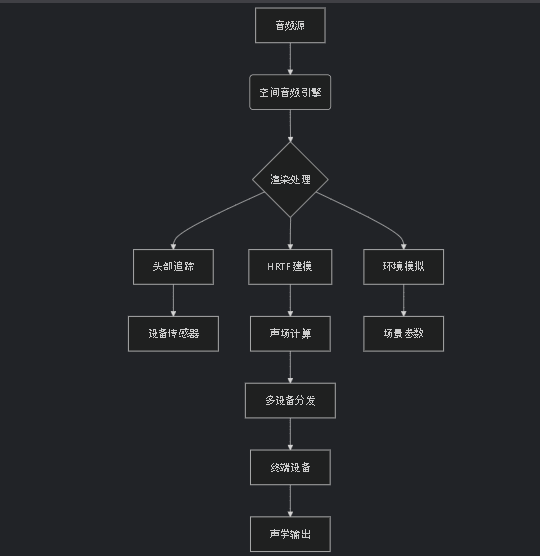

一、空间音频技术架构

1.1 核心组件关系图

1.2 关键技术指标

| 技术 | 作用 | 性能要求 |

|---|---|---|

| 头部相关传递函数(HRTF) | 模拟人耳声音定位 | 512点采样精度 |

| 6DoF追踪 | 头部位置/方向感知 | 延迟<20ms |

| 环境声学建模 | 空间反射/吸收计算 | 实时物理引擎 |

| 跨设备时钟同步 | 多设备音频同步 | 误差<5ms |

二、全景声影院系统实战

2.1 场景设计

-

主设备:智慧屏(视频播放)

-

音频设备:

-

Sound X音箱×2(前置声道)

-

FreeBuds Pro 3(个人环绕声)

-

智能座舱音响(车载扩展)

-

2.2 核心实现

步骤1:初始化空间音频引擎

typescript

import audio from '@ohos.multimedia.audio';

import spatialAudio from '@ohos.multimedia.spatialAudio';

// 创建空间音频渲染器

const spatialRenderer: spatialAudio.SpatialRenderer = await spatialAudio.createRenderer({

renderingMode: spatialAudio.RenderingMode.DYNAMIC_OBJECT, // 动态对象模式

usage: audio.StreamUsage.MEDIA,

format: {

sampleRate: audio.AudioSampleRate.SAMPLE_RATE_48K,

channelCount: 2,

sampleFormat: audio.AudioSampleFormat.SAMPLE_FORMAT_F32LE

}

});

// 配置HRTF模型(使用鸿蒙预置模型)

spatialRenderer.setHrtfModel(spatialAudio.HrtfModel.HUAWEI_CONCERT_HALL);

// 启动渲染

spatialRenderer.start();

步骤2:实现头部追踪

typescript

import sensor from '@ohos.sensor';

// 注册陀螺仪监听

sensor.on(sensor.SensorId.GYROSCOPE, (data) => {

const rotation = {

x: data.x * 0.1, // 弧度转换

y: data.y * 0.1,

z: data.z * 0.1

};

spatialRenderer.updateHeadRotation(rotation);

});

// 注册加速度计监听(位置追踪)

sensor.on(sensor.SensorId.ACCELEROMETER, (data) => {

const position = {

x: data.x,

y: data.y,

z: data.z

};

spatialRenderer.updateHeadPosition(position);

});

步骤3:跨设备音频同步

typescript

import distributedAudio from '@ohos.multimedia.distributedAudio';

// 创建分布式音频组

const audioGroup: distributedAudio.AudioGroup = distributedAudio.createAudioGroup({

groupName: 'home_cinema',

deviceRoles: [

{ type: 'tv', role: 'VIDEO_SOURCE' },

{ type: 'speaker', role: 'FRONT_LEFT' },

{ type: 'speaker', role: 'FRONT_RIGHT' },

{ type: 'earbud', role: 'PERSONAL' },

{ type: 'car', role: 'REAR_SURROUND' }

]

});

// 设置主时钟源(智慧屏作为时钟基准)

audioGroup.setMasterDevice(deviceManager.getDeviceId('TV'));

// 设备加入组

audioGroup.addDevice(speakerLeft);

audioGroup.addDevice(speakerRight);

audioGroup.addDevice(earbuds);

audioGroup.addDevice(carAudio);

// 启动同步播放

audioGroup.play();

三、高级空间音效实现

3.1 动态声场环境模拟

typescript

// 创建虚拟声学环境

const concertHall: spatialAudio.AcousticScene = spatialAudio.createAcousticScene({

roomType: spatialAudio.RoomType.LARGE_HALL,

material: {

left: spatialAudio.WallMaterial.CONCRETE,

right: spatialAudio.WallMaterial.WOOD,

front: spatialAudio.WallMaterial.CURTAIN,

rear: spatialAudio.WallMaterial.BRICK

},

dimensions: { x: 20, y: 10, z: 15 } // 单位:米

});

// 绑定到渲染器

spatialRenderer.setAcousticScene(concertHall);

// 动态改变环境参数(如从大厅切换到洞穴)

function changeScene(sceneType) {

concertHall.setRoomType(sceneType);

// 实时更新混响参数

spatialRenderer.updateReverb(spatialAudio.ReverbPreset[sceneType]);

}

3.2 运动物体音效跟踪

typescript

// 创建动态音频对象(飞机飞过头顶)

const airplane: spatialAudio.SpatialObject = spatialRenderer.createObject({

objectType: spatialAudio.ObjectType.DYNAMIC

});

// 设置运动轨迹

function animateAirplane() {

const path = [

{x: -10, y: 5, z: 0},

{x: 10, y: 5, z: 0},

{x: 10, y: 3, z: -5}

];

let index = 0;

setInterval(() => {

if (index >= path.length) index = 0;

airplane.setPosition(path[index]);

index++;

}, 100); // 每100ms更新位置

}

// 绑定音频源

const planeSound = await spatialRenderer.loadSound('assets/airplane.wav');

airplane.attachSource(planeSound);

planeSound.play();

四、性能优化关键策略

4.1 低延迟优化方案

跨设备时钟同步优化

typescript

class PrecisionClockSync {

private offsets = new Map<string, number>();

// PTP精密时钟协议实现

async calibrateClock(deviceId: string) {

const start = Date.now();

const remoteTime = await distributedDevice.getRemoteTime(deviceId);

const end = Date.now();

const latency = (end - start) / 2;

const offset = remoteTime - (start + latency);

this.offsets.set(deviceId, offset);

}

// 应用时间补偿

adjustTimestamp(deviceId: string, timestamp: number) {

return timestamp - (this.offsets.get(deviceId) || 0);

}

}

头部追踪预测算法

typescript

// 使用卡尔曼滤波预测头部运动

class HeadTrackerPredictor {

private kalmanFilter = new KalmanFilter({

R: 0.01, // 过程噪声

Q: 0.1 // 观测噪声

});

update(position) {

this.kalmanFilter.update(position);

}

predict() {

// 预测50ms后的位置(补偿传输延迟)

return this.kalmanFilter.predict(50);

}

}

4.2 多设备负载均衡

typescript

// 根据设备能力分配计算任务

function assignAudioProcessing() {

const devices = audioGroup.getDevices();

// 按算力排序

devices.sort((a, b) => b.capability - a.capability);

// 分配HRTF计算任务

devices.forEach(device => {

if (device.type === 'car' || device.type === 'tv') {

device.assignTask(spatialAudio.TaskType.HRTF_PROCESSING);

} else if (device.type === 'phone') {

device.assignTask(spatialAudio.TaskType.ENVIRONMENT_REVERB);

}

});

}

五、调试与性能监控

5.1 空间音频调试工具

bash

# 实时声场可视化 hdc shell spatial_visualizer --connect com.example.cinema # 性能监控指标 hdc shell audio_monitor --type spatial --interval 1000

5.2 关键性能指标监控

| 指标 | 监控命令 | 健康阈值 |

|---|---|---|

| 端到端延迟 | audio_monitor --latency |

<80ms |

| HRTF计算负载 | audio_monitor --hrtf |

<40% CPU |

| 跨设备时钟差 | audio_monitor --clock |

<±5ms |

| 丢包率 | audio_monitor --packet |

<0.1% |

六、HarmonyOS NEXT创新特性

6.1 神经声场引擎

typescript

// 使用AI生成个性化HRTF

const personalHrtf = await spatialAudio.generatePersonalHrtf({

earScan: await getEarScanData(), // 耳廓3D扫描

hearingTest: hearingProfile // 听力特征

});

spatialRenderer.setCustomHrtf(personalHrtf);

6.2 分布式声场融合

typescript

// 多房间音频融合

const livingRoom = spatialAudio.createAcousticScene('living_room');

const bedroom = spatialAudio.createAcousticScene('bedroom');

// 开启声场穿透

spatialRenderer.enableSceneFusion({

scenes: [livingRoom, bedroom],

transition: {

type: 'doorway',

position: {x: 5, y: 0, z: 0},

width: 0.9 // 门宽0.9米

}

});

6.3 声纹隐私保护

typescript

// 实时声纹脱敏

spatialRenderer.enableVoicePrivacy({

mode: 'selective_masking',

preserve: ['voice_frequency'], // 保留语音频段

mask: ['ambient_sound'] // 屏蔽环境声特征

});

结语

HarmonyOS空间音频技术通过分布式架构与物理级声学建模的完美结合,实现了跨设备的沉浸式音频体验。

更多推荐

已为社区贡献13条内容

已为社区贡献13条内容

所有评论(0)